前言

2026年1月30日,大门焊死,从伦敦金跳水到国内连续跌停,红了一个礼拜的大盘终于是被贵金属们扣上了绿帽子。

由衷感叹,都说贵金属避险,这下贵金属是必定风险了。

而现在已经来到二月的新一轮周期,外盘继续跌了三天,国内开市的第一天又是迎来大面积的跌停。连续的下跌不知道的还以为爆发什么金融危机了。

当然,事出反常必有妖,也算是读博有点闲钱投资之后亲自见证了这一轮大事件,属实是给我来了个下马威(虽然在下跌之前就把黄金转移到有色金属,但是有色一样被拖累)。之前天天念叨的财神爷也是当天把整个市场画出了最像他的K线。

当然很多人就吐槽是美联储主席任命那一回事。总之也是天天给我推那些神秘营销号的各种奇葩分析,不想看都不行,感觉在污染我正在大学象牙塔里面保护好好的纯真大脑,为了在学死之后可以把自己尸体卖一个好价钱,我决定亲自复盘一下这次历史大事件,过滤一下营销号们的污染杂质。

复盘——水往高处流,除非见鬼了

当然,暴跌之前首先是有涨的。但是投资者都知道期货这玩意大都是缓涨急跌。但好巧不巧的是,在暴跌的前夕出现了急涨——一周涨了30%。真的是,要是存了3年的工资投进去,一个礼拜就能赚一年工资,想想就眼红(一点也不)。对于那些高杠杆的赌狗来说,那断然是不能拒绝这种诱惑了,更何况还是贵金属。

我这种表述显然有误,因为出现急涨的前提反而更多是因为高杠杆的投机者入场。不过不论怎么说,当市场出现大量高杠杆之后,作为学过力学的工科生来说,材料结构够不够硬,决定这个杠杆能翘多高咯。

再往前一步,吸引这些高杠杆的投资者的当然就是黄金的稳定,大幅的上涨。这里能说的点就太多了,不过主要原因还是我们的金毛财神兼职万税爷天天想着刺激他那边消费顺便配合一波关税政策搞得美联储基本走向宽松政策。加上老钟最近的宣传确实也给了点力,大伙是真觉得美元式微了,最典型的就是去年调整利率时候黄金依旧涨——不搭理你了。

好吧,到这一步,RSI都飙升到90了,做空的人都没得活了,大批散户入场一拥而上,看似是上涨的天下了。有钱能使鬼推磨啊,这种逆天的涨势只会让人愈发恐慌,交易倒是实打实得一直飙升。

这个时候,久留美的作者因为逆风做空白银已经被平仓收割了(说了高杠杆一堆赌狗)

重现——沃什:怪我咯?

30号,老特头提名了沃什,这时咱们营销号大哥就会说哎呀,鸽派转鹰派啦,黄金下跌的真正原因来啦~

然而事实是,提名完之后黄金还涨了好几个小时。可能写稿子的机器人不关心炒股。

当然找这个原因也并非有误,只可惜要深究好几层。第一层来说,鸽派转鹰派,就是一个明确信号;但是很明显黄金不是在这个消息出来之后应声而落的,所以第一层并不能说服我。稍微自己查一下会知道,沃什早就从鹰变鸽了,不影响美联储降息的大方向;只可惜无法解释迟来的下跌。如果你一路追高黄金在大气层,对比一下就能明白,之前的预期是大鸽傀儡美联储作为急剧上涨的基本盘,而现在换来一个从鹰变鸽的小涨派——市场是基于预期的,时间就是生命。

那么大涨的根基变为了小涨,材料硬度不够了,该逃顶吗?

散户不清楚,老投资者肯定先出了一波仓了,关键在于主力军,那么谁是主力军?

AI。

想了想还是挺残酷的,但是刚刚好AI就符合这个条件,市场预期动摇,其实就触发斩杀技能了。就算散户的认知里面还在投(当韭菜),但是对于一个黑箱来说,在这种恰好的顶位营造一波收割是最有胜率的大法,什么时候到顶?只需要他们3ms延时的光纤信号转化为他们GPU里面的电势阱里面。也许是一个大户在思考一个小时之后准备出手,也许是当天同时发的COMEX贵金属交割不足的新闻,也可能是快机一步的另一个黑箱率先决策的抛售,短短一分钟之内,一个直角三角形形成了。

而后续?就轮到散户的恐慌抛售了—— 直到下一个上涨。

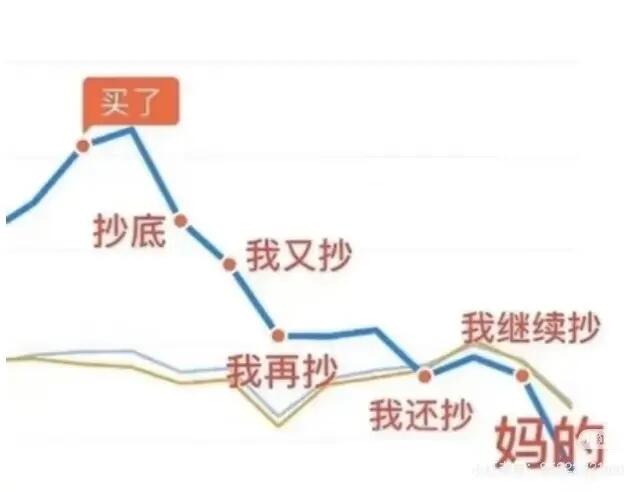

根基在此,一轮抛售结束就该抄底了,毕竟黄金不是股票,上涨趋势还在,只是变弱了而不是消失了,冷静的投资者必然会在中间一个恰好的时机加仓杀入,可喜可贺可喜可贺,一轮涨跌结束了,吗?

虽然是难得一遇的暴跌和迅速回升,但也不至于说载入史册。因为故事才刚刚开始。

再现——什么叫煽风点火大王啊

回顾一下暴跌这几天的K线:

国内慢9h,这里还显示的29号,那个时候还是懂王提名的时间段,这虽然跌了点,变化幅度很大(对应暴跌之后V型回涨),收盘还不是大跌。那么提名第二天发生了啥大事吗?

这一查,还真有。腾讯网:历史性崩盘后,CME再上调金银交易保证金

时间点刚刚好掐在国内周五,伦敦金应声下跌,国内收盘时间紧随其后。

保证金上调先杀了一波高杠杆份子。而周一生效之后更是滚雪球,收割平仓,保证金上调更容易触发平仓,再跌再平仓,高杠杆玩家都哭了。

对于老投资者还有AI们自然也不蠢。。你猜猜谁跑的快。

最后轮到散户,看着一个直插地心的绿色棒子,也该恐慌性抛售了。不过这个就有时间差了,细心点看K线全部长得和我训练AI时候的loss曲线似得(急降变缓)

这一新闻正好对应全部贵金属的下跌。CME年度煽风点火大王,直接促成史上最强暴跌。

马后炮——你也想成为久留美吗

分析完是真爽,写论文做项目可没有这么好逻辑清晰的又方便的。

当然,写到这一步也只是自己搜刮点垃圾货在瞎编瞎盘——论文是怎样水成的。不会真有人能发现我写的独自一人碎碎念觉得自己也行了吧。

很明显前面结论是在这一轮连环爆仓结束之后就可以杀进去了,主线没变,只是被一些外因打了组合拳。但即便如此我也并没有选择加仓,而是攥着老钱继续观望。很多还没提到的消息比如COMEX早在1月27就减仓,而在暴跌之前国内更是多家机构发布了投资预警信号,先对的,国内ETF激增但是还未陷入极端拥挤。市场就是一个巨大的变量,那些在收盘之前看黄金V形回调加仓的人,何尝也不算是分析到位?但是他们算得出来接踵而至的CME保证金上调吗?

也可能我敲完这段文字,有些和我一样想法且行动力强的已经如狼似虎准备抄底了:

不过不论跌涨,我钱其实大头都在短债里面,甚至增持了绿电。。无他,增值稳定,不用盯盘,但是看经济这边的热点笑话还是必不可少的消遣。

毕竟,科技股和现在贵金属这种打打杀杀的市场可是充斥着狗大户和机器人。真玩脱了就是被资本做局或者是被终结者爆杀了。(真不想研究视觉AI了,明明NLP这一类时序AI更好玩啊kora!)